Suchwerkzeuge

| Welche Suchwerkzeuge gibt es?

Internetsuchdienste können nach verschiedenen Kriterien differenziert werden. Grundlegend unterscheidet man, ob es sich um eine manuell (von Menschen) erstellte Dokumentensammlung (z. B. Social Bookmark-Dienste, Internet-Verzeichnisse bzw. Webkataloge) oder auf der anderen Seite um ein rein maschinelles System (daher der Name "Suchmaschine"), d. h. algorithmenbasiertes automatisches System, handelt (z. B. große roboterbasierte Suchmaschinen, Metasucher). |

|

What sort of search tools are there anyway? |

Vorbemerkung

Manuell aufgebaute Link-Sammlungen waren der Beginn bei den Suchdiensten im WWW. Wir werden daher vorerst Linksammlungen/Internetverzeichnisse (in hierarchisch strukturierter Form auch Webkatalog genannt) sowie Social Bookmarkdienste für manuell erstellte Suchdienste erläutern. Große roboterbasierte Suchmaschinen und Metasuchmaschinen für rein maschinelle Systeme werden anschließend behandelt. Spezialsuchmaschinen gibt es für viele Anwendungsbereiche, sie sind, obwohl besonders interessant, eher wenig bekannt. Nachschlagewerke, Fachdatenbanken und Bibliothekskataloge sind weitere Suchdienste, im engeren Sinn aber keine Suchmaschinen. Große Bereiche des Internet werden von Datenbanken abgedeckt, die mit einer allgemeinen Suchmaschine nicht erreichbar sind („Deep Web“, „Invisible Web“). Es handelt sich hierbei in erster Linie um themenspezifische Datenbanken, die erst über Anfragen dynamische Webseiten generieren. Die Anfragen können über das Web gestellt werden, die Seiten werden aber von den Suchmaschinen nicht indiziert. Der größte Teil des „Deep Web“ ist kostenfrei zugänglich, es gibt aber auch eine Reihe von kostenpflichtigen Suchdiensten und Hosts. Man schätzt, dass das „Invisible Web“ für den Wissenschaftsbereich eine Größe von zwischen 20 und 100 Milliarden Dokumenten ausmacht. [1]

Linksammlungen / Internetverzeichnisse, Webkataloge

Schon frühzeitig sammelte man Adressen von Webseiten im WWW in einem Internetverzeichnis. In einfachster Form entstand eine Linkliste. In einem Internetverzeichnis werden die Internetseiten von Menschen aufbereitet. Eine Person oder ein ganzes Redaktionsteam wählt Internetseiten aus. Dabei wird die Internetseite meist einer Prüfung unterzogen. Nach bestandener Qualitätsprüfung wird die Seite im Internetverzeichnis unter einem oder mehreren Themengebieten gespeichert. Bei sehr umfangreichen Verzeichnissen hat sich eine hierarchische Gliederung der Themengebiete bewährt, man spricht dann von einem Webkatalog. Der älteste und sehr umfangreiche Webkatalog ist die Virtual Library (siehe http://vlib.org/). In manchen Verzeichnissen werden die Internetseiten auch bewertet, besonders "gute" Seiten werden z. B. mit einem Sternchen oder einer Lesebrille gekennzeichnet.

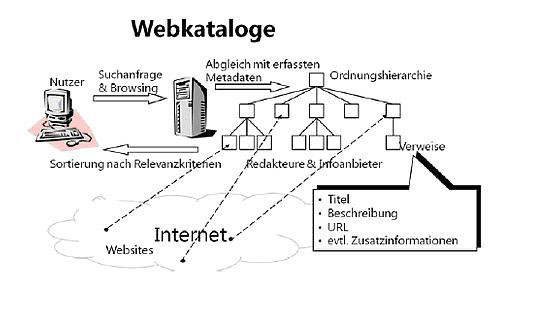

Folgende Abbildung illustriert den konzeptionellen Aufbau von Webkatalogen:

Abb. 1: Aufbau von Webkatalogen [2]

Berühmt ist das Open Directory Project mit dem dmoz-Verzeichnis (siehe http://dmoz.org/). Es handelt sich dabei um den größten Webkatalog, den es derzeit im WWW gibt. Im Mai 2013 verzeichnete das ODP über 5 Millionen Einträge – "über 500.000 davon im deutschsprachigen Teil des Katalogs. Diese sind in über 1.000.000 Kategorien sortiert. Seit der Gründung des Projektes haben mehr als 88.000 Editoren zum Wachstum des Verzeichnisses beigetragen.“[3] Im deutschsprachigen Teil des dmoz-Verzeichnisses (http://www.dmoz.org/World/Deutsch/) findet man 16 Hauptkategorien (z. B. Computer, Wirtschaft, Internet, Gesellschaft, Wissenschaft, Kultur usw.).

In der Hauptkategorie (z. B. "Internet") findet man Unterkategorien (z. B. "Suchen"), dann weitere Unterkategorien (z. B. "Verzeichnisse") sowie Querverweise auf ähnliche Themengebiete (z. B. "Wissen") und wieder weitere Unterkategorien (z. B. Open Directory Project). Um nun eine Seite in einem Internetverzeichnis zu finden, können Sie sich entweder von einer Hauptkategorie bis zu einem Themengebiet durchklicken (das sogenannte Browsing) oder das Internetverzeichnis über eine eingebaute Suchmaschine durchsuchen.

Es existieren große Webkataloge, die versuchen, das ganze WWW abzudecken. Daneben gibt es viele spezialisierte Kataloge, die sich auf ein Land, z. B. Deutschland, oder spezielle Themen beschränken. Die spezialisierten Kataloge werden wir im Kapitel "Spezialisierte Suchdienste" noch näher erläutern.

Gutes internationales Beispiel:

- Verzeichnis http://dmoz.org

Ein guter deutscher Webkatalog:

- Web.de http://dir.web.de/

Ein besonderes Beispiel für ein von Bibliotheken gepflegtes Verzeichnis bzw. Einstiegsportal mit qualitativ hochwertigen Inhalten:

- Lotse Wirtschaftswissenschaften http://lotse.uni-muenster.de/wirtschaftswissenschaften/index-de.php

Die manuelle Auswahl ist aufwändiger und nimmt mehr Zeit in Anspruch als die automatische Indexierung in Suchmaschinen, daher sind diese Verzeichnisse auch viel kleiner als die Indexe der Suchmaschinen. Wenn das größte Verzeichnis etwa 5 Millionen Internetseiten umfasst, ist es von der Anzahl der Links im Vergleich zu einer großen Suchmaschine um etwa den Faktor 10.000 kleiner. Meist sind Internetverzeichnisse jedoch noch deutlich kleiner und bestehen nur aus wenigen tausend ausgewählten Internetseiten. Allerdings können Sie in einem Internetverzeichnis auch Adressen finden, die von Suchmaschinen - technisch bedingt - nicht gefunden werden können. Da es sich in der Regel um bewertete Information handelt, ist die Qualität der Information höher.

Zusammenfassend sollen wesentliche Vor- und Nachteile von Internetverzeichnissen erläutert werden:[4]

Vorteile:

- Webkataloge eignen sich sehr gut für den Einstieg in bestimmte Themen und geben einen ersten Überblick in das Thema.

- Die redaktionelle Aufarbeitung sichert eine minimale Qualität der ausgewählten Webinhalte.

- Die Einteilung erfolgt durch thematische und hierarchische Prinzipien. Dadurch bieten Webkataloge Kontextinformationen.

- Oftmals erfassen Webkataloge eine Vielzahl von hochwertigen (Fach-)Datenbanken, deren Inhalte Suchmaschinen verschlossen bleiben.

Nachteile:

- Bei Webkatalogen fehlt oft ein standardisiertes Regelwerk für die Einordnung. Der hierarchische Aufbau ist von Webkatalog zu Webkatalog unterschiedlich.

- Die Katalogpflege ist sehr aufwändig, vor allem um die Inhalte zu erschließen und jeweils zu aktualisieren.

- Webkataloge decken nur einen Bruchteil des gesamten Webs ab.

Social Bookmarkdienste oder Tagging Communities

Mit dem Entwicklungstrend Web 2.0 wurden Social Bookmarkdienste populär. Social Bookmarks sind Lesezeichen, die in einem Netz mit Hilfe einer Browser-Oberfläche von verschiedenen Benutzern gemeinschaftlich erschlossen werden. Sogenannte Social-Bookmarkdienste wurden für das Sammeln von Links geschaffen. Bekannte Beispiele im internationalen Raum sind Del.icio.us, im deutschsprachigen Raum Mister Wong. Im Gegensatz zu einem Webkatalog geschieht das gemeinsame Indexieren der Links ohne strukturelle oder inhaltliche Vorgaben und Kontrolle. Das heißt, es existiert keine Ordnungshierarchie. Die Webseiten werden mit freien Schlagworten, so genannten Tags versehen, welche gesammelt eine Folksonomy bilden. Eine Tag-Cloud ist dann eine Visualisierung mehrerer Tags. Kommentierte Bookmarks, die frei verschlagwortet wurden, können dann anderen Benutzern zugänglich gemacht werden.

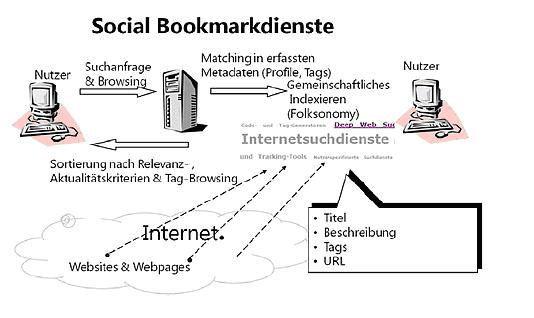

Folgende Abbildung zeigt die Funktionsweise der Social Bookmarkdienste:

Abb. 2: Aufbau von Social Bookmarkdienste [5]

Ein sehr bekannter Social Bookmarkingdienst ist:

- delicious http://delicious.com/

Überblick über populäre Social Bookmarking Websites:

- Top 15 Most Popular Social Bookmarking Websites http://www.ebizmba.com/articles/social-bookmarking-websites

Große roboterbasierte Suchmaschinen

Eine Suchmaschine besteht aus verschiedenen automatisch arbeitenden Programmen, die aufeinander abgestimmt sind und roboterbasierte Verfahren der Dokumentbeschaffung verwenden.

Wie funktioniert eine Suchmaschine?

"Suchmaschinen bestehen im Wesentlichen aus drei Komponenten. Die erste Komponente beschäftigt sich mit der Dokumentbeschaffung. Eine weitere Komponente dient der Inhaltserschließung sowie einer Komponente, welche die Ergebnismenge und deren Sortierung in Bezug zu den gestellten Suchanfragen determiniert." [6] Eine Suchmaschine durchsucht das Internet nicht dann, wenn der Benutzer eine Suchanfrage stellt. Bei den Milliarden von Dokumenten im Internet würde das viel zu lange dauern!

Wie Suchmaschinen arbeiten, wird in einfacher animierter Form bei www.learnthenet.com erklärt.

(siehe http://www.learnthenet.com/animated-internet/how-search-engines-work/)

Folgende Beschreibung zur Funktionsweise einer Suchmaschine stammt aus einer umfangreichen Seite der Informationswissenschaft der Uni Konstanz mit einem Tutorial zur Suche im WWW. Dieses Tutorial ist im WWW leider nicht mehr verfügbar.

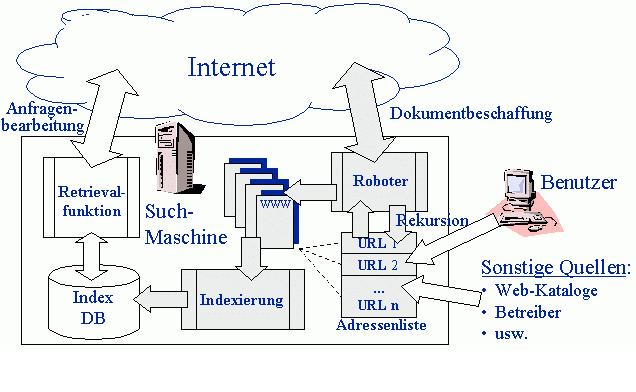

Der technische Aufbau einer Suchmaschine soll hier anhand einer schematischen Darstellung demonstriert werden:

Abb. 3: Systemaufbau einer Suchmaschine

Die Anfragenbearbeitung läuft zunächst als ein einfacher Zugriff auf eine Index-Datenbank ab. Der Nutzer gibt auf einem Web-Formular die Suchbegriffe ein, diese werden dann von der Suchmaschine abgearbeitet.

- Die Benutzerschnittstelle (Interface) ist das Formular und die Webseite, die der Benutzer sieht.

- Der Stichwortindex ist eine große Datenbank.

- Der Suchroboter durchstöbert dauernd das WWW und indexiert dabei gefundene Seiten, d. h. er nimmt die Seiten in einem Stichwortverzeichnis auf.

Ein Suchroboter beginnt seine Wanderung bei bekannten Web-Seiten und folgt dann allen Links, die er auf diesen Seiten findet. So "durchforscht" er immer größere Bereiche des Webs. Er analysiert dabei alle Seiten. Den Prozess nennt man Indexierung, die Datenbank der Suchmaschine nennt man auch Index. Der Suchroboter nimmt dabei alle Seiten, die er auf seinem Weg findet, in seinen Index auf. Je nach Suchmaschine indexiert er nur Titel und die ersten paar Zeilen jedes Dokuments oder gleich das ganze Dokument. Große Suchmaschinen erfassen Unmengen von Web-Seiten. Ein Crawler kann einige Milliarden Seiten pro Tag indexieren. Im Juli 2008 umfasste der Index von Google laut Wikipedia [7] bereits 1 Billion Dokumente (gepostet von Jesse Alpert & Nissan Hajaj, Software Engineers, Web Search Infrastructure Team im offiziellen Googleblog [8]). Google gibt keine aktuellen Zahlen zum Index bekannt. Mit großer Sicherheit kann man davon ausgehen, dass es hunderte Milliarden Seiten sein werden.

Crawler können nur Internetseiten indexieren, die über einen Link erreichbar sind. Es entgehen ihnen aber viele Seiten - eben alle, die nicht über einen Link erreichbar sind oder die in irgendeiner Weise gegen Zugriffe geschützt sind. „Suchmaschinen finden selten topaktuelle Inhalte. Ein Suchroboter benötigt einige Zeit, bis er das WWW durchstöbert hat und mit der Suche wieder von vorne beginnt (z. B. 1 Monat). Es kann auch passieren, dass die Suchmaschine auf eine Seite hinweist, die der Suchanfrage gar nicht entspricht. Dann hat der Autor der Seite den Inhalt seit dem letzten Besuch des Suchroboters geändert.

„Bei Suchmaschinen sehr wichtig ist das sogenannte "Ranking". Ein Verfahren, das bestimmt, in welcher Reihenfolge die zum gesuchten Begriff gefundenen Webseiten ausgegeben werden. Sucht man beispielsweise bei einer der großen Suchmaschinen, etwa Google, nach einem populären Begriff wie MP3, so bekommt man hunderte Millionen Treffer – alle Seiten, die den Begriff MP3 irgendwo im Text enthalten. Es ist offensichtlich, wie wichtig es ist, ein Verfahren zu finden, um relevante Webseiten möglichst weit oben zu platzieren. Aus Sicht eines Webmasters hingegen ist es entscheidend, seine eigene Seite weit nach oben zu bringen, um viel "Traffic" zu erhalten. Der genaue Ranking-Mechanismus ist das jeweils bestgehütete Geheimnis der Suchmaschinen." [9]

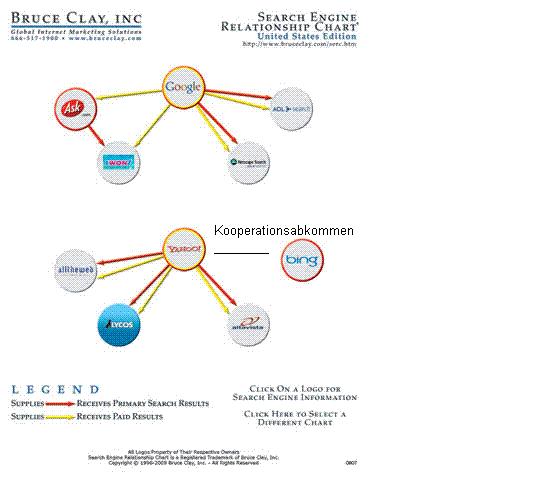

Obwohl es zwar viele Suchmaschinen gibt, haben es nur wenige wirklich geschafft, von den Anwendern wahrgenommen zu werden. Zu den führenden Suchmaschinen gehören Google, Yahoo und die Suchmaschine Bing von Microsoft. Die hohe Dominanz von Google führte Anfang August 2009 zu einer Ankündigung einer Kooperation von Yahoo und Microsoft. Die Partner hatten vereinbart, dass Yahoo seine Suchmaschine einstellt und die neue Microsoft-Suche Bing nutzt. Der Vorteil der Kooperation ist für beide Seiten eine größere Reichweite, die höhere Werbeerlöse bringt. [10]

Beziehungen von Suchmaschinen sind in der folgenden Abbildung ersichtlich:

Abb. 4: Searchengine Relationship Chart [11]

Gewisse Suchmaschinen versuchen das ganze WWW abzudecken (z. B. http://www.bing.com), andere spezialisieren sich auf einen bestimmten Teil des WWW (z. B. Moose).

Die bekanntesten großen internationalen Suchmaschinen:

- Google http://www.google.at

- Bing - Suchmaschine von Microsoft http://www.bing.com

- Yahoo! http://www.yahoo.com

Ein gute österreichische Suchmaschine ist http://www.moose.at/.

Metasuchdienste & Metasuchmaschinen

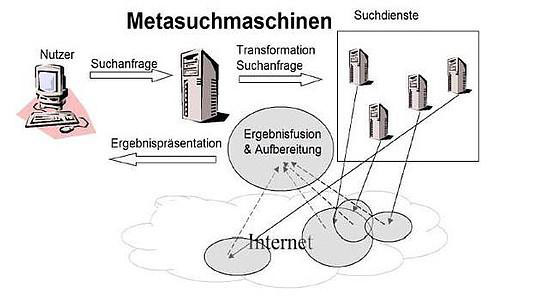

Eine Metasuchmaschine ist eine Suchmaschine, die eine Suchanfrage gleichzeitig an mehrere Suchmaschinen und Kataloge weiterleitet, die Ergebnisse sammelt und entsprechend aufbereitet. Metasuchmaschinen brauchen daher keinen eigenen Index. Um zu sinnvollen Ergebnissen zu kommen, müssen doppelte Treffer, also solche, die bei mehreren Suchmaschinen gefunden werden, aussortiert werden. Zur Bewertung der Ergebnisse ist die Aufstellung eines eigenen internen Rankings notwendig. Die Ergebnisse werden dann einheitlich, wie in einer Suchmaschine, dargestellt. Die älteste Metasuchmaschine, die auch international einen hohen Bekanntheitsgrad hat, ist der Metacrawler. Der Metacrawler wurde vom Computer Science Departement der Universität von Washington entwickelt.

Grundsätzlich kann das Angebot durchsuchbarer Quellen erweitert werden. So nutzt die leistungsstarke Metasuchmaschine Clusty auch die freie Enzyklopädie Wikipedia, ebay sowie Weblogs und Nachrichtendienste. Weiters bietet diese Metasuchmaschine auch interessante Zusatzfunktionen wie ein Clustering der Ergebnisse.

Eine einfache WWW-Seite mit mehreren Suchmasken verschiedener Suchmaschinen ist keine Metasuchmaschine. Die folgende Abbildung gibt die Funktionsweise von Metasuchdiensten wieder:

Abb. 5: Funktionsweise von Metasuchmaschinen [12]

Mit einer Metasuchmaschine spart man sich Zeit durch die gleichzeitige Suche in vielen verschiedenen Suchdiensten. Einschränkungen gibt es bei Suchfunktionen (kleinster gemeinsamer Nenner bei der Verwendung bestimmter Operatoren). Die Trefferqualität ist so gut wie die Trefferqualität der verwendeten Suchdienste, wobei noch berücksichtigt werden muss, dass nur eine eingeschränkte Anzahl von Treffern für die Metasuchmaschine verwendet werden kann. Schwierig ist das Ranking der gemischten Treffermenge. Da die Rankingwerte der einzelnen Suchdienste unterschiedlich und die Verfahren meist nicht offiziell bekannt sind, wird die Treffermenge meist nach den Suchdiensten gruppiert.

Metasuchdienste sind besonders gut geeignet für Informationsprobleme, bei denen man genau weiß, was man will. Bei sehr spezifischen Informationsanfragen weisen einzelne Suchdienste in der Regel nur wenige Treffer auf. Metasuchdienste bündeln diese Ergebnisse und beinhalten Suchdienste oder spezielle Datenbanken, die sonst nicht verbreitet bzw. bekannt sind. Bei der Darstellung der Ergebnisse kann die Visualisierung der Ergebnisse eine Hilfestellung sein (z. B. bei Searchcrystal).

Die bekanntesten internationalen Metasuchmaschinen:

- Yippy http://yippy.com/

- Ixquick http://www.ixquick.com

- Dogpile http://www.dogpile.com

- Zoo http://www.zoo.com

Die beste deutsche Metasuchmaschine:

- Metager http://www.metager.de

Spezialsuchmaschinen und Suchmaschinenverzeichnisse

Spezialsuchmaschinen sind eine interessante Ergänzung einer großen allgemeinen Suchmaschine. Durch die Einschränkung auf ein bestimmtes Themengebiet oder auf Dokumentenmerkmale (z. B. Datentyp) gelingt es in der Regel besser, für eine bestimmte Zielgruppe genauere Ergebnisse zu erzielen. Dieser Bereich wird dann häufig vollständiger indexiert als von einer allgemeinen Suchmaschine. Spezialsuchmaschinen bieten häufig auch mehr Suchmöglichkeiten an, die auf diesen Bereich optimiert sind. In einer Spezialsuchmaschine für Filme gibt es z. B. die Möglichkeit, direkt nach Filmtiteln, Regisseuren, Schauspielern oder Charakteren zu suchen. Spezialsuchmaschinen eignen sich daher besonders gut, wenn sie nur einen bestimmten Bereich im Internet durchsuchen wollen. Beschäftigt man sich mit einem speziellen Thema, sind spezielle Verzeichnisse ein guter Einstieg in das jeweilige Thema. Für beinahe jedes Thema gibt es schon spezielle Suchverzeichnisse bzw. Suchmaschinen.

Grober Überblick Spezialsuchmaschinen

Es ist unmöglich, einen kompletten Überblick über die gesamte Landschaft der Spezialsuchmaschinen zu geben. Eine Hilfestellung dazu geben Verzeichnisse von Spezialsuchmaschinen, wie z.B. Searchenginewatch Specialty Search Engines http://searchenginewatch.com/article/2065024/Specialty-Search-Engines

Die bekanntesten internationalen Verzeichnisse:

- Beaucoup http://www.beaucoup.com

- Complete Planet http://www.completeplanet.com

- Weitere Verzeichnisse http://einkauf.oesterreich.com/info/cat_detail.asp?cat=508

Ausgewählte Bereiche der Spezialsuche

Nachrichtensuchmaschinen

- Newssuche http://www.paperball.de

- Google News http://news.google.at

Personensuchmaschine

- Personensuche http://www.yourtraces.com/

Weitere Beispiele:

- Techniksuchmaschine http://www.sjn.de

- Suchmaschine bzw. Datenbank für Filme, MovieDatabase http://www.imdb.com/

- Libdex – Worldwide Index of Library Cataloges http://www.libdex.com/

- Verzeichnisse von weltweiten Telefonbücher http://www.telefonbuch.com

- Fachzeitungen http://www.fachzeitungen.de/

- Archivsuchmaschine A digital library of internet sites http://www.archive.org

Suchmaschinenverzeichnisse - Suchmaschinen über Suchmaschinen

Deutschsprachige Suchmaschinenverzeichnisse:

- Die Suchmaschinen Datenbank - die Suchmaschinen-Liste http://www.suchmaschinen-datenbank.de/

- Suchmaschinenverzeichnis mit mehr als 600 Suchmaschinen http://www.suchmaschinen-online.de

Internationales Verzeichnis:

- Searchenginecolossus http://www.searchenginecolossus.com/

- This section of Search Engine Watch lists some top choices in various categories. http://searchenginewatch.com/static/guides

Tipp: Gute Einstiegsseiten mit qualitativ hochwertigen Inhalten:

Fahrplan für LOTSE Wirtschaftswissenschaften – Wählen Sie Ihren Einstieg!

http://lotse.uni-muenster.de/wirtschaftswissenschaften/index-de.php

New York Times Newsroom Guide to Useful Web Sites:

http://topics.nytimes.com/top/news/technology/cybertimesnavigator/index.html

Datenbanken und Tools für wissenschaftliche Recherchen

Über das Internet sind verschiedene Datenbanken, zum Teil kostenlos, erreichbar, die für das wissenschaftliche Arbeiten notwendig sind. Ein empfehlenswerter Ausgangspunkt dafür ist die Digitale Bibliothek der Universitätsbibliothek Linz. Diese bietet unter http://www.jku.at/UB/content/e997/ den Zugang bzw. einen Link u.a. zu folgenden Datenbanken

- Katalogdatenbanken: Diese umfassen die Bestände der Bibliothek. Der Verbundkatalog umfasst weiters die Bestände der Bibliotheken des Österreichischen Bibliothekenverbundes.

- Die elektronische Zeitschriftenbibliothek (EZB) umfasst die Titel (nicht den Inhalt) von beinahe 20.000 Zeitschriften, die online verfügbar sind. Für jede Zeitschrift wird dargestellt, ob deren Inhalte a) generell online zugänglich sind, b) nur über das Universitätsnetz bzw. bestimmte Computer an der Universität (d. h. die Universität Linz hat eine Lizenz), oder c) nicht zugänglich sind (aber ev. sind die Abstracts für eine Suche verfügbar).

- Manche wissenschaftliche Verlage bieten eine Volltextsuchmöglichkeit und den Zugang zu ausgewählten bzw. allen Zeitschriftenartikeln an (z. B. die ScienceDirect Datenbank des Elsevier-Verlages http://www.sciencedirect.com).

- Möchte man eine Suche über Zeitschriften verschiedener Fachrichtungen und Verlage durchführen, gibt es wieder spezielle Datenbanken, die dies ermöglichen. Wie z. B. die INSPEC Datenbank für Naturwissenschaften. Diese sind ebenfalls online zugänglich. Idealerweise geben die Suchergebnisse an, ob ein gesuchter Artikel im Zeitschriftenbestand der betreffenden Bibliothek vorhanden ist.

- Von besonderer Bedeutung für das wissenschaftliche Arbeiten sind die „ISI-Datenbanken“, die zusätzlich zu den üblichen Suchfunktionen die Suche nach Zitaten (!) ermöglichen. In Ermangelung der allgemeinen Verfügbarkeit kann auf http://scholar.google.com zurückgegriffen werden.

Zum Vereinfachen der Organisation der gefundenen Literaturquellen ist das Programm EndNote ein De-Facto-Standard. Es ermöglicht nicht nur die Organisation der Literatur, sondern auch den direkten Zugang zu wissenschaftlichen Datenbanken, sodass eine Suchanfrage mehrmals verwendet werden kann. Für die Suche „im Internet“ (d.h. nicht unter Verwendung der erwähnten wissenschaftlichen Datenbanken) gibt es Programme, die die Verwendung von Suchmaschinen und die Organisation der Suchresultate wesentlich erleichtern, wie beispielsweise Copernic. Dieses Tool ermöglicht Suchstrategien, die mit der alleinigen Verwendung von (Meta-)Suchmaschinen (noch) nicht möglich sind. (Anmerkung: Von den in diesem Absatz beschriebenen Programmen sind voll funktionsfähige Trial-Versionen im Internet verfügbar.)

Ausgewählte wissenschaftliche Datenbanken und Suchmaschinen:

- Deutschsprachige Literatur für Wiwi, Sowi, Psychologie.. http://www.wiso-net.de/

- Fachinformation Technik und Naturwissenschaft http://www.getinfo-doc.info/

- Fachportale - Liste der Virtuellen Fachbibliotheken und Fachportale http://vascoda.wordpress.com/fachportale/

- Directory of Open Acess Journals http://www.doaj.org/

- Google Scholar – durchsucht wissenschaftliche Server http://scholar.google.at/

- LLEK Wissenschaftliche Suchmaschinen http://www.llek.de

- Science Direct http://www.sciencedirect.com

Literatur

Quellen

- ↑ Dirk Lewandowski and Philipp Mayr, Exploring the Academic Invisible Web, in: Library Hi Tech, 2006, Volume 24, Issue 4, S. 529 – 539

- ↑ Griesbaum, J / Bekavac, B. / Rittberger, M., Typologie der Suchdienste im Internet, Heidelberg 2009, S. 19

- ↑ http://de.wikipedia.org/wiki/Open_Directory_Project (7.5.2013)

- ↑ http://sprint.informationswissenschaft.ch/allgemeine-suche/suchverfahren/katalog-verzeichnis/ (16.3.2011)

- ↑ Griesbaum, J / Bekavac, B. / Rittberger, M., Typologie der Suchdienste im Internet, Heidelberg 2009, S.25

- ↑ vgl. Griesbaum, J / Bekavac, B. / Rittberger, M., Typologie der Suchdienste im Internet, Heidelberg, 2009, S. 28

- ↑ http://de.wikipedia.org/wiki/Google#cite_note-17 (14. 8. 2009)

- ↑ http://googleblog.blogspot.com/2008/07/we-knew-web-was-big.html (14. 8.2009)

- ↑ http://www.suchmaschinentricks.de (14. 8. 2009)

- ↑ http://de.biz.yahoo.com/05082009/345/kooperation-microsoft-yahoo-haelt-mehrere.html (14. 8. 2009)

- ↑ http://www.bruceclay.com/serc_histogram/histogram.htm, (15.8.2009)

- ↑ Griesbaum, J / Bekavac, B. / Rittberger, M., Typologie der Suchdienste im Internet, Heidelberg, 2009, S. 44

- ↑ Katzlinger Elisabeth und Robert Zlabinger, Suche im Internet, in Skriptum Informationsverarbeitung 1, Manfred Pils (Hrsg.), 10. Auflage März 2008, S. 140 f.

Weiterführende Links

- Suchmaschinen-Tutorial der Universitätsbibliothek Bielefeld

- net.TUTOR der Ohio State University Libraries

- Die Suchfibel. Alles über Suchmaschinen

Zitiervorschlag

Zlabinger in Höller, Informationsverarbeitung I, Suchwerkzeuge (mussswiki.idb.edu/iv1)